ASPETTI FILOSOFICI

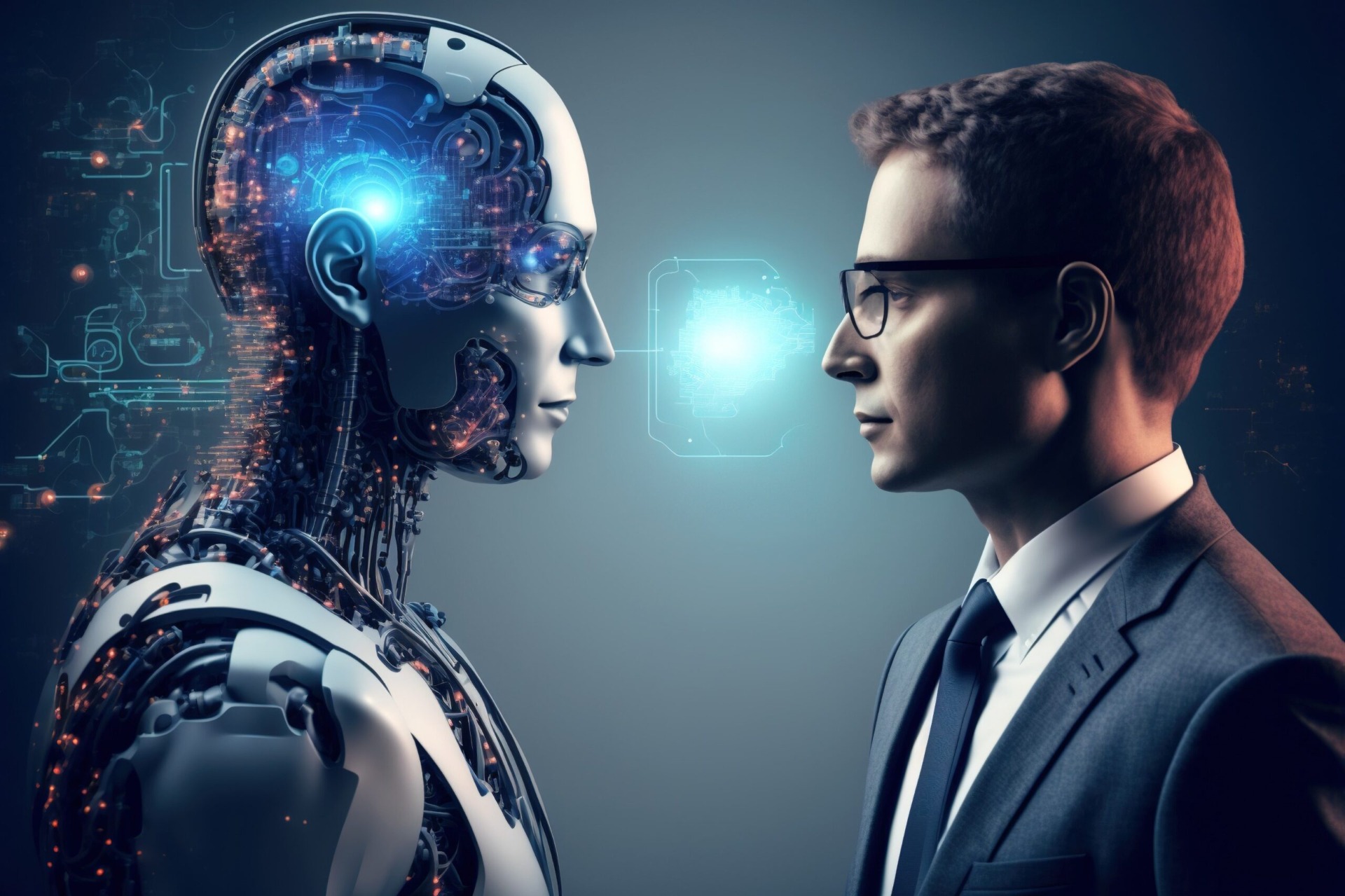

L'intelligenza artificiale non è solo una questione tecnologica, ma anche un grande tema filosofico. Il suo sviluppo solleva interrogativi profondi su cosa significhi essere umani, pensare, decidere e agire. Quando una macchina inizia a prendere decisioni, ci chiediamo: può davvero "capire"?.

Con l'avvento dell'IA, ormai, si pensa che non è più solo l'uomo a ragionare, ma anche sistemi artificiali capaci di apprendere, prevedere e influenzare il comportamento umano.

Inoltre, possiamo fidarci di decisioni prese da un sistema automatico? E soprattutto: quale ruolo vogliamo affidare alle macchine nella nostra società?

Queste domande non hanno risposte semplici, ma mostrano chiaramente che parlare di intelligenza artificiale significa anche parlare di etica, diritti, e del futuro dell'umanità stessa.

LA MENTE E' UNA MACCHINA?

- DUALISMO VS MATERIALISMO -

🧠 1. DUALISMO-CARTESIO

Cartesio sostiene che mente e corpo siano due realtà separate:

-

Res cogitans: la mente (pensiero, coscienza ed anima).

-

Res extensa: il corpo (materia).

➡ la mente non è una macchina: non può essere ridotta ai processi materiali del cervello.

🔍 Problema: come comunicano mente e corpo? Cartesio parla della ghiandola pineale, ma questa idea è oggi molto discussa.

⚙ 2. Materialismo – visione moderna

I materialisti pensano che la mente derivi dal cervello. Quindi:

-

Il cervello è visto come una macchina biologica, simile a un computer.

➡ La mente è una macchina, determinata da meccanismi fisici e algoritmi.

🤔Conclusione

-

Se fosse solo un algoritmo, potrà essere copiato, migliorato e forse superato dall'IA.

-

Se invece contenesse elementi immateriali, la mente umana resterebbe unica ed irripetibile.

La questione fondamentale è questa: la mente è solo un algoritmo biologico o c'è qualcosa di più?

💡Comprendere questa distinzione è essenziale per riflettere sul futuro dell'intelligenza artificiale e sul significato stesso dell'essere umani.

L'IA PUO' PENSARE O AVERE COSCIENZA?

- SEARLE E LA "STANZA CINESE" -

🧠 1. IL PROBLEMA

Le intelligenze artificiali (come ChatGPT) sembrano dialogare, capire il linguaggio, risolvere problemi.

Ma lo fanno davvero? O stanno solo simulando il pensiero, senza capirlo?

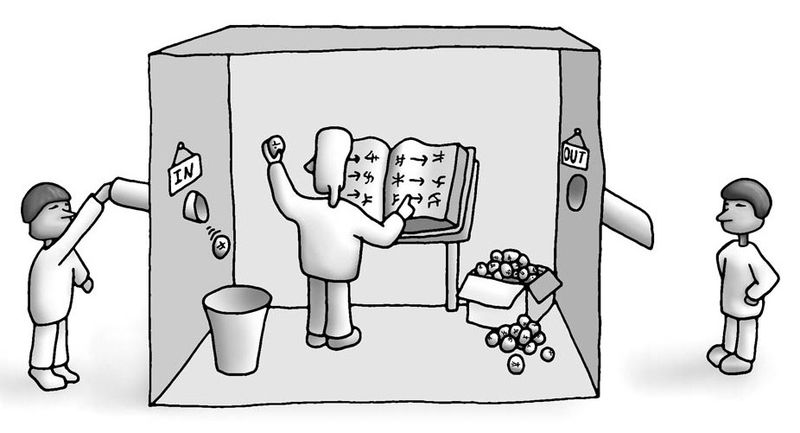

🏮 2. La "Stanza cinese" (Searle, 1980)

Searle propone un esperimento mentale:

-

Una persona è chiusa in una stanza, senza conoscere il cinese.

-

Ha un manuale (tipo un programma) con regole su come rispondere ai simboli.

-

Riceve simboli in cinese (input) e risponde con altri simboli (output), seguendo solo le regole grammaticali.

➡ Dall'esterno sembra che "capisca" il cinese, ma in realtà sta solo manipolando i simboli senza capirne il significato. Questo è ciò che fa un computer : elabora solo la sintassi (regole), ma non conosce la semantica (significato). Dunque Un computer può simulare l'intelligenza, ma non ha intenzionalità, cioè non dà significato a ciò che elabora. Quindi: L'IA non pensa davvero e non ha coscienza.

🤖 Conclusione

Chi difende l'IA forte sostiene che:

-

Se una macchina si comporta in modo intelligente, allora è intelligente.

-

Se passa il Test di Turing, può essere considerata pensante.

📌 Per loro, la mente è software e il cervello è l'hardware:

➡ Quindi, un computer può avere mente se ha il programma giusto.

L'IA PUÒ ESSERE CONSIDERATA COME UNA PERSONA MORALE?

Secondo la filosofia morale, una persona deve possedere caratteristiche fondamentali: autocoscienza, razionalità, libertà e responsabilità. Le IA, però, non hanno consapevolezza di sé, non provano emozioni né hanno intenzioni proprie. Le loro azioni dipendono da algoritmi e dati, non da scelte libere o consapevoli. L'Intelligenza Artificiale è oggi al centro di molte riflessioni etiche e filosofiche. Una delle domande più interessanti è se possa essere considerata una persona morale, cioè un soggetto capace di distinguere il bene dal male e di assumersi la responsabilità delle proprie azioni. Anche se possono imitare comportamenti morali, questa è solo una simulazione: non c'è vera comprensione o responsabilità. Oggi, infatti, le conseguenze delle azioni di un'IA ricadono sempre sugli esseri umani che la progettano o la utilizzano.

In conclusione, allo stato attuale, un'IA non può essere considerata una persona morale, perché le manca ciò che rende tale un essere umano: la coscienza, la libertà e la capacità di scegliere tra il bene e il male in modo autonomo.

DIFFERENZA TRA SIMULARE L'INTELLIGENZA ED ESSERE INTELLIGENTI

- SIMULARE L'INTELLIGENZA -

Simulare l'intelligenza significa riprodurre un comportamento che appare intelligente, senza che ci sia una reale comprensione, coscienza o intenzionalità.

Questa simulazione avviene tipicamente attraverso sistemi artificiali come chatbot, assistenti virtuali o software di intelligenza artificiale, che utilizzano dati, algoritmi e modelli statistici per generare risposte coerenti o utili.

Tuttavia, dietro queste risposte non c'è un'esperienza consapevole, ma solo una elaborazione automatica di informazioni.

- ESSERE INTELLIGENTI -

Essere intelligenti significa possedere realmente la capacità di comprendere, apprendere, ragionare, adattarsi e risolvere problemi, in modo consapevole.

L'intelligenza vera coinvolge anche aspetti emotivi, sociali ed etici, come l'empatia, la capacità di prendere decisioni morali, e di relazionarsi con gli altri.

Inoltre, essere intelligenti implica agire con uno scopo, avere motivazioni profonde e la consapevolezza della propria esistenza e delle proprie azioni.

- LE DIFFERENZE -

Comprensione:

-

La simulazione elabora dati senza capirne il significato.

-

L'intelligenza autentica comprende concetti, contesto ed emozioni.

-

-

Coscienza e intenzione:

-

Le macchine non sono consapevoli e non hanno volontà.

-

L'essere umano pensa, sceglie e agisce con intenzionalità.

-

-

Esperienza soggettiva:

-

L'IA non prova emozioni né ha esperienze interiori.

-

L'intelligenza vera si nutre di esperienze, empatia e riflessione.

-